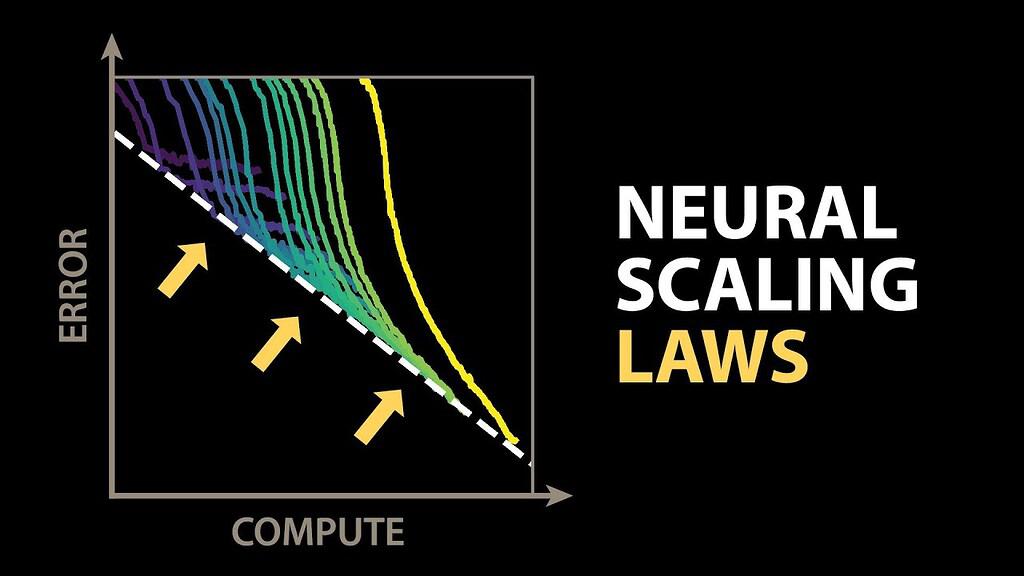

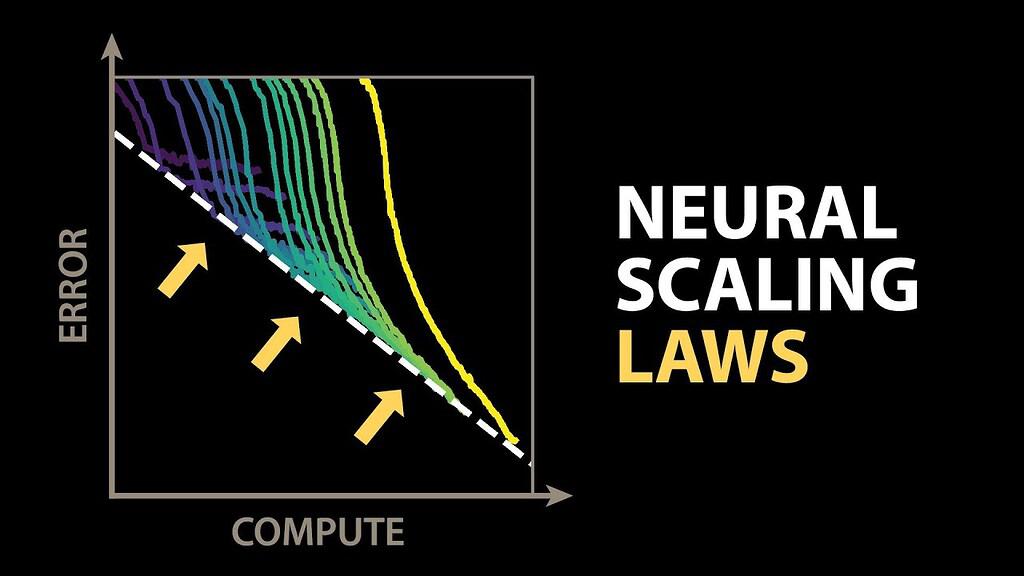

Scaling Law 的神奇在于,不只是预训练,甚至包括 RL 训练、推理时计算,都非常好的遵循 Scaling Law 。一个高中生就能根据它,准确预测未来模型的性能,只需要告诉他投入了多少算力!

这让我好奇,在当前,它到底有没有放缓,会不会放缓呢?因为这点决定了很多事情。

但即使对于这样简单的一个问题,也存在着矛盾的 2 面:一方面,大模型厂商的数据都是保密的,自 OpenAI 变成 CloseAI 后,似乎少有数据从它们内部发表出来;与之矛盾的另一方面,是这些大模型厂商又都在同一时段,取得了非常接近的成果!这是否说明,有某些信息其实是半公开的,有共识的,只不过没人主动揭开那层面纱?就比如现实世界的缩放定律能维持到什么时候这样一个基础的问题?

然后我开始了搜索,先是找到了 36kr 的这篇文章:( GPT-5 被吐槽没进步? Epoch 年终报告打脸:AI 在飞速狂飙,ASI 更近了)

https://eu.36kr.com/zh/p/3609407158404102

里面发现了这句关键,「 OpenAI 、Anthropic 在 2025 年初就曾表示,它们当前的 RL 扩展速度最多只能维持 1–2 年」!——吐槽下,这句话也恰好印证了大模型厂商的保密,连做 AI 的同行也不知道 RL 扩展时效这些基本的东西。

我每天都在关注 AI ,奇怪的是我听到的都是「没有墙」、「 Scaling Law 没有放缓,只是换了形式」,这个 1-2 年的说法从哪儿来的呢?

于是顺藤摸瓜,找到了这篇很有意思的文章: ( RL 缩放的效果如何?)

https://www.lesswrong.com/posts/xpj6KhDM9bJybdnEe/how-well-does-rl-scale

这个作者 Toby_Ord 真的很厉害,他用我们每天都能看到的模型 benchmark 图,就推算出了 RL 的效率相比预训练的效率的数量关系(这也是 Scaling law 的魅力所在)。然后他根据算力投入,得出了 RL 缩放在算力上不可持续的结论。真的是非常典型的人类「少样本学习」。

根据作者的分析,可以描绘出一个很简洁的关于大语言模型在缩放定律下发展的故事图景:2025 年是 RL 缩放辉煌的一年,而在这之前的 2024 年末,o1 模型,引爆了 RL 缩放,那时候,基于预训练的缩放,由于数据耗尽无法大规模扩张,陷入了困境,而 RL 缩放来得恰逢其时,每次将 10x 算力用于 RL 训练,都能获得稳步的性能提升,这与预训练的缩放情形何其类似!虽然 10x 算力用在 RL 训练上带来的提升,效率低些,不如用在预训练上的提升,但关键是起点不同,当时的预训练已经处在一个非常高的位置(比如每次训练花费动辄数十亿美元),再持续放大 10 倍是不可想象的,而 RL 训练还处在非常早期,意味着 10x 算力可能只相当于 100 万美元级别的投入,再 10x 也不过才 1000 万美元。Anthropic 的 CEO 阿莫代伊在 2025 年初说过,我们还处于 RL 缩放曲线非常早期的位置。这也是 2025 年大模型蓬勃发展的原因,每隔 3~4 个月,就有一个新版本的模型诞生。不过,一旦 RL 训练所需的算力追平预训练所需的算力,RL 缩放将无法再持续,它的效率甚至比预训练还低,根据 Toby_Ord 的计算,提升相同性能所需的算力倍数是预训练的平方。这也因应了「 RL 只能持续 1-2 年」的说法。

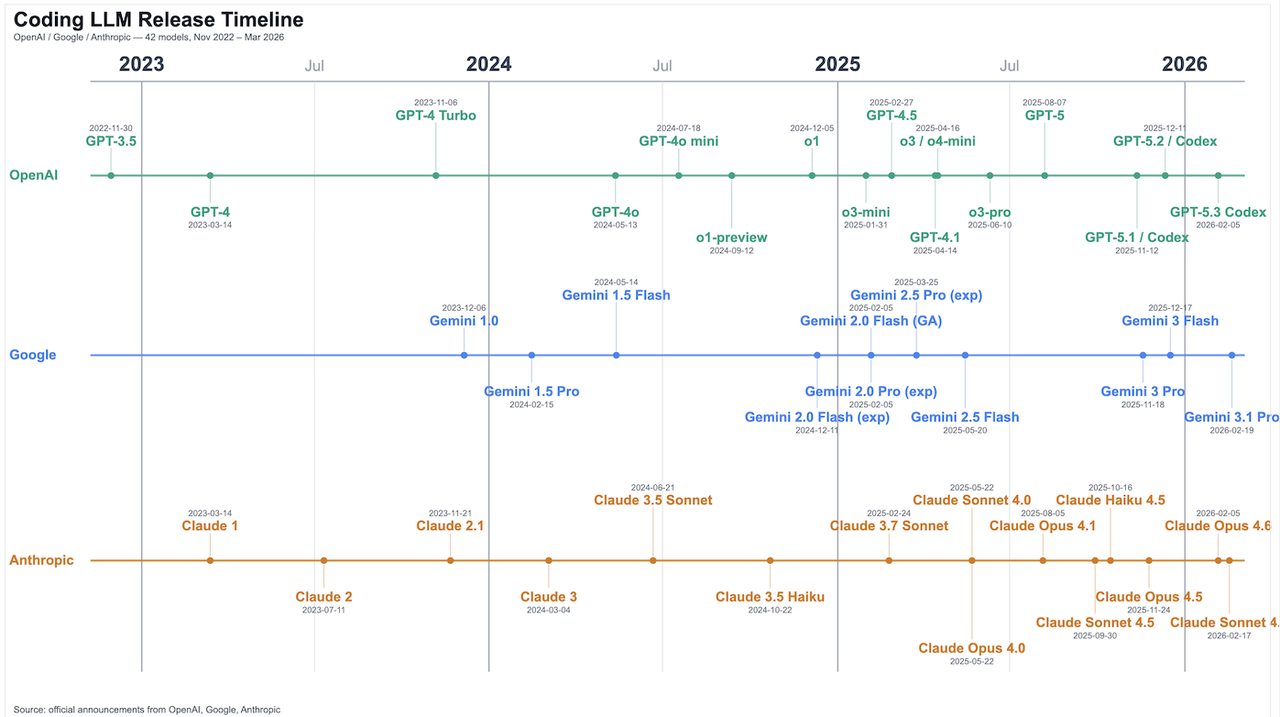

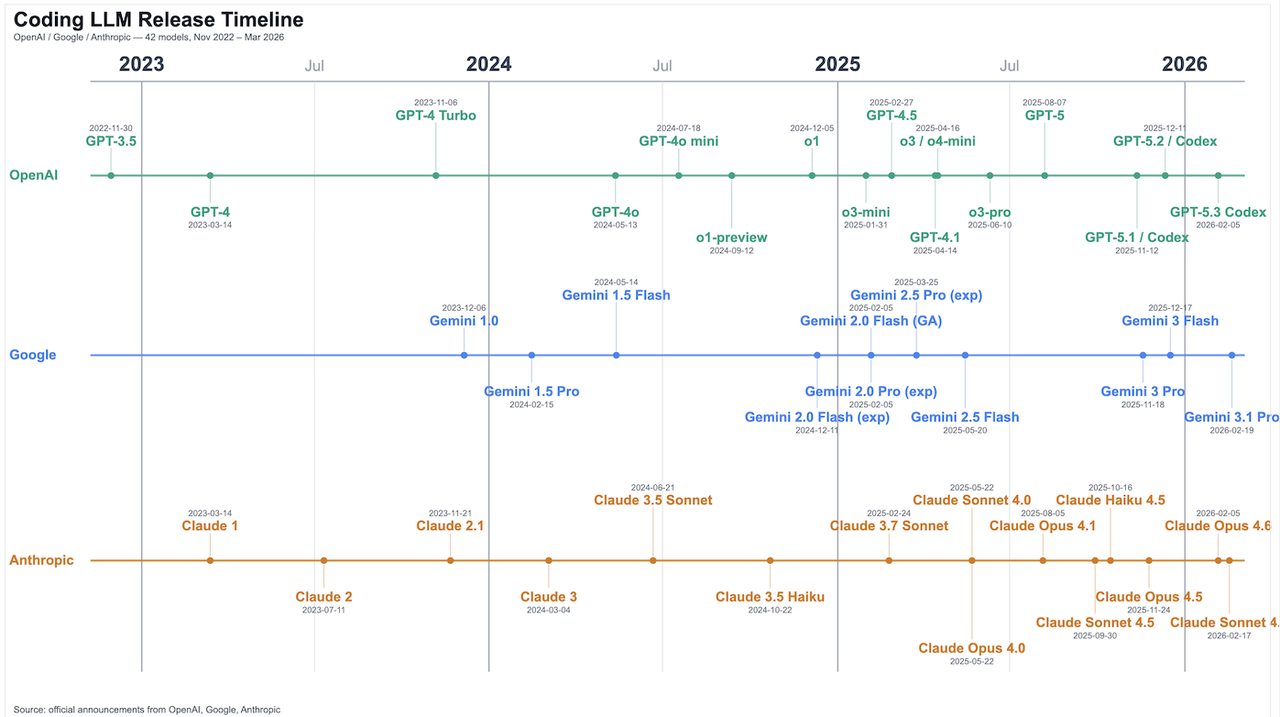

2026 年,似乎是缩放定律的一个关键时间节点。下面这张模型发布时间图,在 2026 年,会怎样变化呢?

上图中,最有意思的是 Claude 模型的命名:3.0, 3.5, 3.7, 4.0, 4.1, 4.5, 4.6 ,这些数字代表什么,是不是根据缩放定律取得的进步程度呢,间隔越大性能提升越高?它最近的模型发布时间间隔与命名编号,是不是证实了 RL 缩放在放缓呢?

这让我好奇,在当前,它到底有没有放缓,会不会放缓呢?因为这点决定了很多事情。

但即使对于这样简单的一个问题,也存在着矛盾的 2 面:一方面,大模型厂商的数据都是保密的,自 OpenAI 变成 CloseAI 后,似乎少有数据从它们内部发表出来;与之矛盾的另一方面,是这些大模型厂商又都在同一时段,取得了非常接近的成果!这是否说明,有某些信息其实是半公开的,有共识的,只不过没人主动揭开那层面纱?就比如现实世界的缩放定律能维持到什么时候这样一个基础的问题?

然后我开始了搜索,先是找到了 36kr 的这篇文章:( GPT-5 被吐槽没进步? Epoch 年终报告打脸:AI 在飞速狂飙,ASI 更近了)

https://eu.36kr.com/zh/p/3609407158404102

里面发现了这句关键,「 OpenAI 、Anthropic 在 2025 年初就曾表示,它们当前的 RL 扩展速度最多只能维持 1–2 年」!——吐槽下,这句话也恰好印证了大模型厂商的保密,连做 AI 的同行也不知道 RL 扩展时效这些基本的东西。

我每天都在关注 AI ,奇怪的是我听到的都是「没有墙」、「 Scaling Law 没有放缓,只是换了形式」,这个 1-2 年的说法从哪儿来的呢?

于是顺藤摸瓜,找到了这篇很有意思的文章: ( RL 缩放的效果如何?)

https://www.lesswrong.com/posts/xpj6KhDM9bJybdnEe/how-well-does-rl-scale

这个作者 Toby_Ord 真的很厉害,他用我们每天都能看到的模型 benchmark 图,就推算出了 RL 的效率相比预训练的效率的数量关系(这也是 Scaling law 的魅力所在)。然后他根据算力投入,得出了 RL 缩放在算力上不可持续的结论。真的是非常典型的人类「少样本学习」。

根据作者的分析,可以描绘出一个很简洁的关于大语言模型在缩放定律下发展的故事图景:2025 年是 RL 缩放辉煌的一年,而在这之前的 2024 年末,o1 模型,引爆了 RL 缩放,那时候,基于预训练的缩放,由于数据耗尽无法大规模扩张,陷入了困境,而 RL 缩放来得恰逢其时,每次将 10x 算力用于 RL 训练,都能获得稳步的性能提升,这与预训练的缩放情形何其类似!虽然 10x 算力用在 RL 训练上带来的提升,效率低些,不如用在预训练上的提升,但关键是起点不同,当时的预训练已经处在一个非常高的位置(比如每次训练花费动辄数十亿美元),再持续放大 10 倍是不可想象的,而 RL 训练还处在非常早期,意味着 10x 算力可能只相当于 100 万美元级别的投入,再 10x 也不过才 1000 万美元。Anthropic 的 CEO 阿莫代伊在 2025 年初说过,我们还处于 RL 缩放曲线非常早期的位置。这也是 2025 年大模型蓬勃发展的原因,每隔 3~4 个月,就有一个新版本的模型诞生。不过,一旦 RL 训练所需的算力追平预训练所需的算力,RL 缩放将无法再持续,它的效率甚至比预训练还低,根据 Toby_Ord 的计算,提升相同性能所需的算力倍数是预训练的平方。这也因应了「 RL 只能持续 1-2 年」的说法。

2026 年,似乎是缩放定律的一个关键时间节点。下面这张模型发布时间图,在 2026 年,会怎样变化呢?

上图中,最有意思的是 Claude 模型的命名:3.0, 3.5, 3.7, 4.0, 4.1, 4.5, 4.6 ,这些数字代表什么,是不是根据缩放定律取得的进步程度呢,间隔越大性能提升越高?它最近的模型发布时间间隔与命名编号,是不是证实了 RL 缩放在放缓呢?